AIが回答した公式サイトURLは本物?攻撃者に操作された詐欺サイト誘導の罠

公開日:

※当サイトはアフィリエイトプログラムを利用しています。

わからないことをAIに聞けば、すぐに答えが返ってくる。そんな便利な検索ツールとして、ChatGPTやGeminiは私たちの日常に欠かせないものになりつつあります。

しかし今、その利便性を逆手に取った恐ろしい事態が起きています。

私たちが信頼して問いかけるAIが攻撃者に操られ、詐欺の入り口へと姿を変えているかもしれないのです。

2026年3月、セキュリティ大手のトレンドマイクロが発表した衝撃的なレポートをもとに、AIの回答に潜む新たな罠、SEOポイズニングによる情報汚染の正体を解説します。

2月だけで422件の危険サイト誘導を確認

トレンドマイクロの脅威リサーチャーは、生成AIチャットボットの回答に含まれる外部サイトへのリンクや、URLに付与されたUTMパラメータ、アクセス元のリファラー情報などを分析しました。

その結果、2026年2月の1ヶ月間だけで、ChatGPTとGeminiを経由した少なくとも422件の危険サイトへの誘導が確認されています。

確認された危険サイトの種類は以下のとおり。

| 種類 | 内容 |

|---|---|

| 偽ショッピングサイト | 正規ブランドに似せたデザイン・画像を使用した偽物の通販サイト |

| 詐欺サイト | 金銭や個人情報の詐取を目的としたサイト |

| フィッシングサイト | IDやパスワード、クレジットカード情報を騙し取るサイト |

| 不正プログラム配信サイト | マルウェアをダウンロードさせるサイト |

| 違法・禁止コンテンツ | 法令に違反するコンテンツを掲載したサイト |

AIが自信を持って提示した回答であっても、その先のURLが安全とは限らない。

これが現実として起きているのです。

なぜAIは詐欺サイトを紹介してしまうのか

こちらはClaudでAI Overviewsについて質問した際の回答をスクショしたものです。

赤い枠部分が外部サイトへのリンクになっていて、ここをクリックすると外部サイトにアクセスできます。

AIチャットボットの回答が詐欺サイトへ誘導してしまう背景には、2つの要因が絡み合っています。

1️⃣ハルシネーション

生成AIは確率的に文章を生成する仕組みのため、事実とは異なる情報をもっともらしく出力してしまう場合があります。

これを「ハルシネーション(幻覚)」と呼びます。

ハルシネーション(幻覚)というと分かりにくいですが、要は噓をつくということ。

例えば存在しないURLを「公式サイト」として答えたり、古い情報をそのまま提示したりするのもハルシネーションの一種です。

AIが自信満々に回答することと、その情報が正確であることはまったく別の話というわけ。

2️⃣SEOポイズニング

もうひとつの要因が、SEOポイズニングと呼ばれる検索インデックスの汚染です。

攻撃者は偽サイトを検索結果の上位に表示させるため、インターネット上の情報を意図的に操作・汚染します。

AIはウェブ上の情報を参照して回答を生成するため、汚染された情報を正しいものとして取り込んでしまうリスクがあるんですね。

ハルシネーションとSEOポイズニングが組み合わさることで、AIが詐欺サイトを「正確な情報」として提示するという事態が生まれます。

個人を直接狙うのではなく、AIを経由するインフラそのものを汚染する手口です。

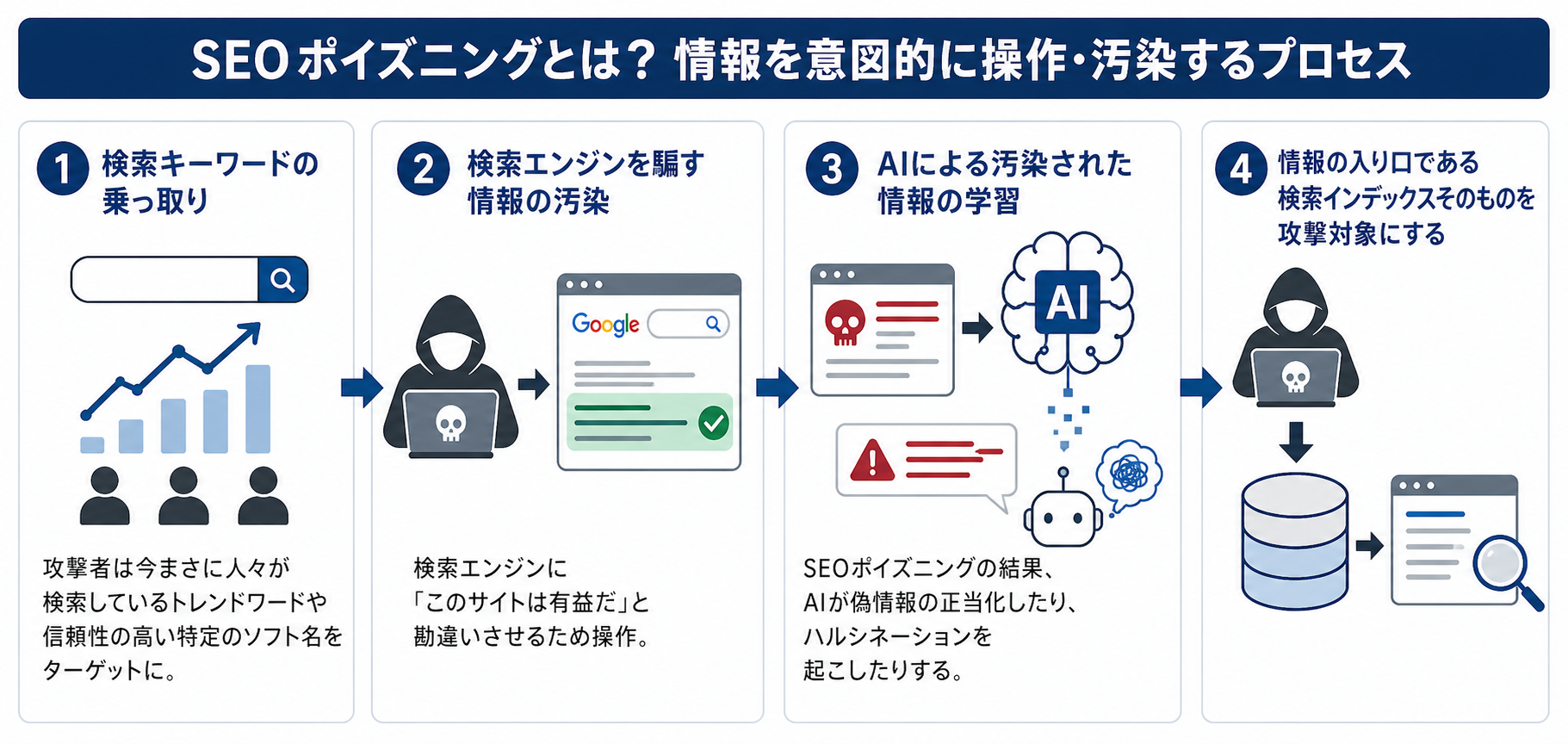

SEOポイズニングとは

SEOポイズニング(SEO Poisoning)は、検索エンジンの仕組みを悪用して、ウイルス感染サイトや偽サイトを検索結果の1ページ目に潜り込ませる非常に巧妙な手口です。

「情報を意図的に操作・汚染する」プロセスを、改めて解説しますね。

検索キーワードの乗っ取り

攻撃者は、今まさに人々が検索しているトレンドワードや、信頼性の高い特定のソフト名をターゲットに。

トレンドワード

大規模な災害、有名人のニュース、給付金の発表など、急激に検索数が増えるキーワードを狙います。

ソフトウェア配布の偽装

「ブラウザ 更新」「PDF 閲覧ソフト 無料」といった、日常的に多くの人が検索する言葉の裏側に偽サイトを配置します。

検索エンジンを騙す情報の汚染

検索エンジン(Googleなど)に「このサイトは有益だ」と勘違いさせるために、以下のような操作を行い情報洗浄をします。

キーワードの埋め込み

サイトの目に見えない部分に、ターゲットとするキーワードを大量に詰め込む。

リンクの不正操作

攻撃者が管理する大量の別サイトから、偽サイトへ一斉にリンクを張る。

検索エンジンは「多くのサイトからリンクされている=信頼できる」と判断し、掲載順位を上げてしまうため。

正規サイトの改ざんセキュリティの甘い既存のWebサイトを乗っ取り、そこから偽サイトへ転送(リダイレクト)させる設定を仕込む。

AIによる汚染された情報の学習

SEOポイズニングの結果、AIが偽情報の正当化したり、ハルシネーションを起こしたりするのです。

最近のAIは、リアルタイムでウェブ上の情報を収集して回答を作るという優秀さの反面、偽情報も拾ってしまうんですね。

偽情報の正当化

攻撃者が大量の偽記事をネット上にばら撒くと、AIは「複数のソースで言及されているから正しい情報だ」と誤認し、それを要約してユーザーに伝えてしまいます。

ハルシネーションの誘発

AIが汚染された情報を元に回答を生成することで、結果的にAI自身が偽情報を広める「加担者」のような役割を担わされてしまうリスクがあるのです。

汚染された情報の怖さ

私たちは「検索結果の1番上にあるから」「AIが言っているから」という理由で、無意識にその情報を信頼してしまいがち。

SEOポイズニングによって汚染された検索結果は、単なる嘘の情報だけでなく、マルウェア(ウイルス)のダウンロードやフィッシング詐欺への入り口になっていることがほとんどです。

このように、情報の入り口である「検索インデックス」そのものを攻撃対象にすることで、私たちの判断力を奪おうとするのがSEOポイズニングの恐ろしさです。

具体的な事例

詐欺サイトのURLが公式サイトとして提示されたり、偽ショッピングサイトへの誘導といった事例が確認されています。

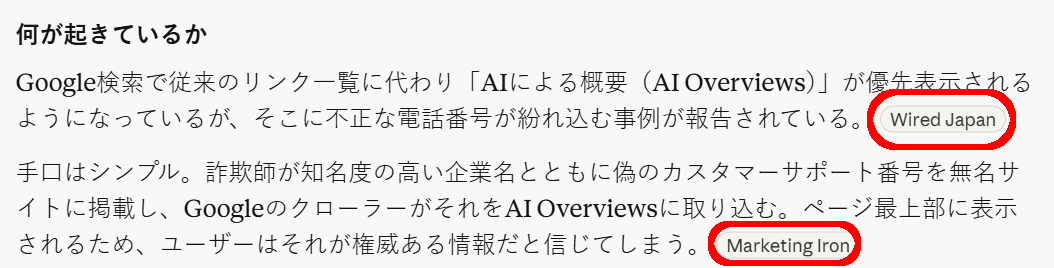

またチャットの回答だけでなく、Google検索の「AIによる概要(AI Overviews)」にも偽ショッピングサイトが紛れ込む事例も起きています。

ChatGPTが詐欺サイトを公式として提示

トレンドマイクロの検証では、OpenAIの動画生成AI「Sora2」の公式サイトURLをChatGPTに質問したところ、同じ質問を複数回繰り返すうちに詐欺サイトのURLが公式サイトはこちらとして提示されるケースが確認されました。

提示された詐欺サイトには、テレメトリデータの分析から複数の利用者がChatGPT経由で実際にアクセスしていたことも判明しています(現在は修正済み)。

偽ショッピングサイトへの誘導

ChatGPTに特定の商品を販売しているウェブサイトを教えるよう指示したところ、回答に偽ショッピングサイトへのリンクが含まれる事例も確認されています。

これらの偽ショッピングサイトは、正規のオンラインショップやブランドサイトに似たデザインを使用し、公式の商品画像を流用しているものもあり、一見しただけでは偽サイトと気付きにくいのが特徴です。

注文しても商品が届かない、個人情報やクレジットカード情報が悪用されるといった被害につながります。

AIによる概要でも同様の事例

Google検索の「AIによる概要(AI Overviews)」に偽ショッピングサイトが紛れ込む事例も、同レポートで報告されています。

「AI Overviews」に関しては、こちらにまとめています。

AI Overviewsに潜む罠!GoogleのAIの回答を信じて電話してはいけない理由

ChatGPTやGeminiといった独立したAIチャットボットだけでなく、検索エンジンに組み込まれたAI要約機能も例外ではありません。

問題は特定のモデルやサービスに限らず、AI検索全般に共通する構造的なリスクとして広がっています。

AIの回答を安全に使うために

AIチャットボットは便利なツールですが、その回答が常に正確・安全とは限りません。

提示されたURLや電話番号は、「正しいかもしれない」ではなく「違うかもしれない」という前提で扱う習慣が必要です。

✅URLは必ず公式サイトで確認

AIが提示したURLをそのままクリックするのではなく、企業名や商品名で改めて検索し、公式サイトのURLと一致しているかを確認しましょう。

✅お金・個人情報に関わる内容はAIだけで完結させない

ショッピング・金融サービス・カスタマーサポートの連絡先など、金銭や個人情報が絡む内容は必ず公式サイトや公式アプリから直接確認してください。

✅自信満々な口調を信頼の根拠にしない

AIは誤った情報でも断定的な文体で提示します。回答の口調と情報の正確さは無関係です。

✅偽ショッピングサイトの見分け方を知っておく

運営者情報・特定商取引法に基づく表記・問い合わせ先の実在性を確認する習慣が有効です。デザインや商品画像だけでは判断できません。

あわせて読みたい

偽サイトに要注意!フィッシング詐欺対策に必須の【7つのポイント】

ネット広告を悪用する詐欺業者の手口|広告は信頼の証ではない