あなたをデジタル上で複製?ディープ・バイオメトリクスが引き起こす脅威とは

※当サイトはアフィリエイトプログラムを利用しています。

私たちが日常的に使うパスワードやPINは、万が一漏洩しても「変更」すれば済む話です。

しかし、生体データだと、指紋や虹彩は同じ人がいない上、生涯変わらないのはあなたもご存じでしょう。

その利点を生かし、スマホの認証に生体認証を使っている人も多いと思います、私もネットショッピングなどに便利なので使うのは当たり前。

その生体認証に何かしらの危機があるとしたらどうでしょう。

特に指紋認証なんかだと、私の場合なら映画やドラマでたまに見かける「犯罪に巻き込まれて無理やり」といった場面が浮かびます。

指紋が盗まれる=犯罪に巻き込まれるといった風に考えていました。

でも、そんな考えは改めてほうが良さそうだと感じるニュースを見ましたので、生体認証の危機について、あなたと情報を共有したいと思います。

生体認証のリスクが生じた背景

GeminiなどのAIサービスが一気に拡大しているのはあなたもご存じかと思います。

AIというと拒否反応を示す人でも「優秀な画像編集ソフト」という位置付けでガンガン使ってると思うんですよ。

特に先日登場した「nano banana」という画像生成サービスは、単に画像を編集するという「作業」を超えた「楽しさ」をユーザーに提供するものです。

世界中の人が「これすごいね」「めっちゃ楽しい」と利用している感じ。

「nano banana」に自分の画像をアップして、髪色を変えたり、洋服を変えたりしても、元画像が崩れにくいというのが最大の特徴なんですね。

上の画像は、ゴミ袋に入ってご満悦のうちの猫を「nano banana」にアップして「この画像を王様ぽっくして」と指示して「もちろんです!この猫ちゃんを王様っぽく変身させますね!」と出てきた画像。左が元画像、右がAIによる生成画像です。

一度しか指示していないのに、中々やるじゃんです。

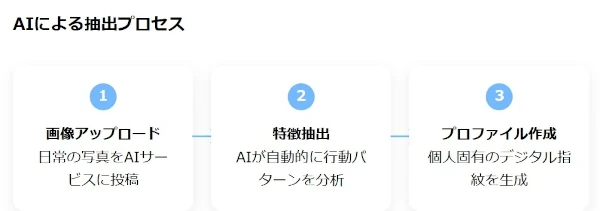

そういった画像生成のAIサービスにアップロードされた画像から抽出されるものの中に、バイオメトリクスが含まれます。

また、AIの進化によって、行動的特徴まで加味される「ディープ・バイオメトリクス」というものもあります。

今回はそのディープ・バイオメトリクスにまつわる脅威のお話です。

ディープ・バイオメトリクスとは

生体データは、人間の生涯を通じてほとんど変化しません 。

この「高い信頼性」は上でも触れたように、セキュリティでは非常に有利ですが、ひとたびシステムから流出すると、あなた自身をデジタル上で再現できる情報が永久に固定されてしまうことを意味します。

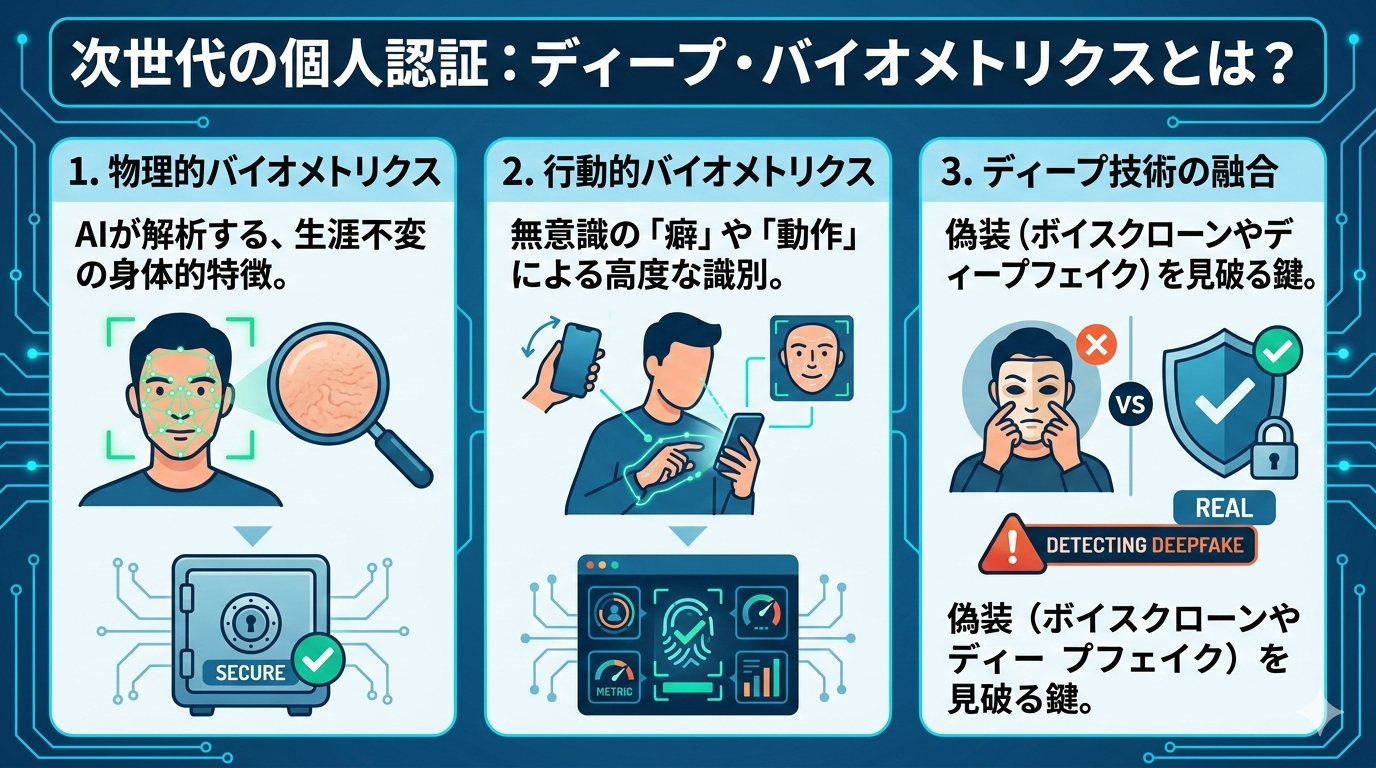

ディープ・バイオメトリクスとは、身体的特徴と行動パターンを複合した、生涯変更不可能な高次元の個人識別情報です。

抽出過程は、ユーザーに目に見えない状態、内容や意図が公開されていない状態で行われます。

この情報には、固有の顔面の配置や皮膚の質感といった、これまでもあった物理的特徴に加え、微かな表情、スマートフォンの持ち方、典型的な撮影角度といった行動的特徴までもが含まれるんです。

確かに「なくて七癖」ではないですが、行動にもその人の特徴があらわれるので、物理的特徴と行動的特徴の組み合わせは限りなくパーソナルな情報だといえます。

ディープ・バイオメトリクスの特徴

| データ種別 | 具体的な要素 | 生体認証の種類 | センシティブ度(永続性リスク) |

|---|---|---|---|

| 身体的バイオメトリクス | 固有の顔面の配置、皮膚の質感、体のプロポーション | 物理的(Static) | 高(生涯不変性が高い) |

| 行動的バイオメトリクス | 微かな表情、スマートフォンの持ち方 | 行動的(Dynamic/Cognitive) | 中~高(習慣的、変動が緩やか) |

| 行動的バイオメトリクス | 典型的な撮影角度、構図の選択 | 行動的(Behavioral Pattern) | 高(個人の習慣を強く反映) |

AIが導き出すディープ・バイオメトリクス

AIは画像のピクセル情報から、人間が意識しないレベルの詳細な特徴を捉え、ディープ・バイオメトリクスを導き出します。例えば、スマートフォンの持ち方や体のプロポーションを画像から導き出すためにこれらを高精度で抽出。

- ・手や指の正確な配置

- ・デバイスと被写体の相対的な位置関係

- ・姿勢の微細なブレ

AIはこれらの空間的・幾何学的配置を分析し、あなたのデバイス操作時の習慣、すなわち行動的バイオメトリクスの一部を特定するそうです。

AIの特徴の一つとして、AIに与えられた情報は「数値化」され、AIが理解し、必要に応じて人間が理解できる形(言語など)に再変換して出力します。

空間的・幾何学的配置な分析はAIの得意分野だから、行動的バイオメトリクスの一部を特定できるというわけ。

あなたの好きな撮影角度を知っている

AIが画像を生成する時、画像を分析する時の能力を少しだけ覗いてみましょう。

1️⃣画像生成段階

あなたがAIに「ローアングルで撮影した、そびえ立つビルの写真」と指示(プロンプト)を与えると、AIはその言葉を数値化して理解。

AIは膨大な量の学習データから、「ローアングル」という概念が、被写体を見上げるような視点や、空が広く写り込む構図と関連していることを学習済みです。

この数値化された理解に基づき、AIは指示通りの構図で画像を生成します。

これは、AIが人間の言葉を幾何学的な配置に変換する能力を示しています。

2️⃣画像分析

次に、このプロセスの逆を考えます。

あなたが日常的に撮影した写真をAIにたくさんアップロードしたとするでしょ?

AIは、それらの画像一枚一枚分析して、構図のメタデータを抽出。

これは、写真に写っている主要な被写体の位置や、撮影した視点の高さ、背景との関係性などを数値として読み取る作業になります。

例えば、AIがあなたが撮った沢山の写真を分析した結果、このような傾向を発見するかもしれません。

- ・被写体が常に目線の高さにあることが多い。

- ・風景写真では、広角レンズで奥行きを強調する構図が多い。

- ・食事の写真では、真上から撮った「バードアイビュー」の構図が頻繁に使われている。

これらの分析結果を統合して、AIは「あなた固有の行動パターン」を学習するんです。

AIがあなたの視覚的な情報から、その背後にある、あなたの好みや習慣を推測できてしまうというわけ。

そいったパーソナライズされた情報は、あなたの生活に様々な便利さや豊かさ、そしてあなたがこれまでできなかった経験さえ、もたらしてくれますよ。

データ抽出が引き起こす重大な危機

AIの進化は、あなたにとってポジティブな情報ばかりではありません。

同時にネガティブな情報も存在することを忘れないでほしいのです。

AIの脅威に関しては他にも記事を書いています。

ページの最後に掲載していますので、お時間があればぜひ読んでくださいね。

このデータ抽出が何故あなたにとって危機を引きおこすのでしょう。

法的な問題

過去にはこういったものもあったようですね。

OECD AI

・Google、AI顔認識をめぐるイリノイ州の生体認証プライバシー訴訟を和解

日本の個人情報保護法 (PIPA) の適用

Googleはグローバルサービスですが、ここは日本。日本の法律に鑑みるとどうなのか私も気になるので、簡単に。

PIPAの下では、顔のパターンや指紋などの生体データは通常「要配慮個人情報」として扱われます。

その取得には原則として本人の同意が必要とされ、利用目的を明確に特定しなければならないんですね。

Googleのようなグローバルサービスが日本ユーザーのデータを処理する場合、利用規約において、行動的バイオメトリクス抽出という利用目的が、ユーザーに理解できる形で明示され、同意が得られているかが厳しく問われます。

この利用目的が不明確である場合、法令違反となる可能性が高い。

Googleのプライバシーポリシーでは

では実際にGoogleではどうなのかをGeminiに質問してみました。

「Googleには行動的バイオメトリクス抽出という利用目的が、ユーザーに理解できる形で明示されている?」と。

Geminiの回答はこんな感じ

明確な回答として、Googleの利用規約やプライバシーポリシーに「行動的バイオメトリクス抽出」という言葉が直接的に明示されているわけではありません。

しかし、ユーザーが入力した情報ややり取りのデータをサービス改善のために分析・利用することは、一般的なAIサービスの利用規約と同様に明記されています。

Googleのプライバシーに関する考え方

Googleは、ユーザーのプライバシー保護に重点を置いており、以下のような方針を公開しています。

プライバシーの尊重

Googleはユーザーのプライバシーを重視しており、個人情報を販売することはありません。

データの非特定化

Geminiアプリでのチャット内容は、人間のレビュー担当者が見る前にユーザーの個人アカウントから切り離され、匿名化されます。

学習への利用

レビューされたチャットデータは、Geminiの基盤となる機械学習モデルの改良には直接使用されません。

広告への利用

Geminiでのやり取りが広告表示の目的で使用されることはありません。

これらのポリシーは、ユーザーのデータがどのように収集され、何のために利用されるかについて透明性を提供することを目的としています。

ユーザーが日常的にアップロードする画像やテキストから構図の好みを学習するような分析は、AIのサービス改善という大枠に含まれると考えられます。

これは、特定の「行動的バイオメトリクス」という言葉を使うよりも、より広範で包括的な表現です。

実際に改めてプライバシーポリシーを読んでみましたが、「行動的バイオメトリクス」自体に特に触れている部分はなく、一般的なプライバシーポリシーといった印象を私は持ちました。

約束と現実のギャップ

リスクの中心にあるのは、「利用規約とAIの実際のデータ処理能力との間に存在する乖離の可能性」だと指摘されています。

この問題は、AIサービスを使う際の「あなたの写真は何に使われますか?」という、サービス側がした約束(利用規約)と、AIが実際にできること(能力)の間に大きなズレが生じているために起こります。

📌利用規約が想定していること

AIサービスが画像をアップロードする際にユーザーと交わす契約(利用規約)では、通常、次のような目的を想定しています。

約束の内容

「あなたの写真を分析して、AIの性能を上げます」とか、「あなたの画像を元に新しい画像を生成します」といったものです。

あなたの認識

あなたは、自分の顔やペット、風景など、被写体の情報が使われるのだろう、と認識しています。

📌AIの持つ能力

しかし、最新のAIは性能が良すぎるために、サービス側が意図していないことまでできてしまう。

あなた自身は当然、「そんなことまで頼んでない」「そんな約束はしてない」となるでしょ?

AIの持つ能力が高いがゆえに、上に書いた行動的バイオメトリクスを頼まずとも抽出してしまうのですからね。

📌ギャップがもたらす問題

この「約束」と「現実の能力」の間のギャップが、深刻なプライバシー問題を引き起こします。

| 要素 | 説明 | なぜ問題か |

|---|---|---|

| ユーザーは知らない | ユーザーは、自分がアップロードした写真から行動パターンが抜き取られていることを知らされていません。 | サービス側が透明性を欠いており、ユーザーの信頼を裏切ります。 |

| 厳格な同意の欠如 | 行動的バイオメトリクスは、法律上、生体データと同じくらい厳重に扱うべき情報です。しかし、利用規約にはその抽出について明確な説明や同意がない可能性があります。 | 法律が要求する厳格な同意が得られていないため、サービス提供者は大規模な訴訟リスクを負うことになります。 |

| 制御できない | サービス提供者が「この情報は使わないで」とAIに指示しても、AIは高性能すぎて勝手に抽出・保存してしまう可能性があります。 | サービス提供者がデータ処理を完全に制御できていない状態にあり、プライバシー保護の責任を果たせなくなります。 |

AIが、利用規約で「使わない」と約束したはずの、極めてプライベートな情報(あなたの癖や習慣)を、「勝手に抜き取って記録しているかもしれない」という点に問題があるというわけなんですね。

画像をアップロードするときに、AIがその画像から生体認証レベルの行動的バイオメトリクスを抽出することを予期している人は少ないのでは?と思います。

私自身、正直に言うと、たとえばGeminiにアップした画像が、行動的バオメトリクスを抽出されているのでは?と考えたことがありませんでした。

実は今回のニュースで、AIがこういった抽出をしていると知ったのです。

私が撮影する写真は愛猫が99%を占めますし、その写真はGoogleDriveを利用して保存しています。

自身の写真は身分証明書用に撮影する程度で、用が済めば削除しているんですね。

でも行動的バイオメトリクスって上にも書いたように「被写体が常に目線の高さにあることが多い」といったものも含まれるわけじゃないですか。

だとするなら、「私が撮影する愛猫の写真は撮影者の目線が多い」になるかもしれないんだなあ。

可愛い瞬間を自分の目で見たように再現したいからなんですけどね。

そいったものもAIを使うと抽出されるって、ちょっとゾッとしました。

話がそれましたが、利用規約に記載され、それをユーザーが理解しているかどうかも、もちろん大事なポイントなのですが、そもそも利用規約やプライバシーポリシーを隅々までしっかり読み込んでいるのか?という部分での心配もありますね。

仮に読んでいても「行動的バイオメトリクスとは?」といった説明がなされていなければ理解できない可能性が高くなる。

また、「難しいことが書いてある」と感じると、最後まで読もうとしなくなりますもんね。

生体データ悪用の可能性

生体データは変更が不可能なため 、一度流出するとあなたに対し永続的なアイデンティティ詐称リスクを負わせることになるでしょう。

従来のパスワードやPIN番号と異なり、指紋や顔のパターンといった物理的特徴は、生涯にわたってほとんど変化しません。

このため専門家は、一度流出した生体データはユーザーを「永久に危険な状態にする」と強く警告しているのです。

収集されたあなたの生体認証データは、悪徳業者によって高値で売買されるだけでなく、ディープフェイクを使った詐欺、金融詐欺、ロマンス詐欺、さらには政治的・企業スパイ活動といった様々なサイバー犯罪に悪用される可能性があります。

ディープ・バイオメトリクスは、物理的特徴と行動的パターンが複合されているため、単一の顔画像データよりも遥かに「固有性」が高く、詐欺師が利用できるアイデンティティプロファイルの精度が劇的に向上します。

アイデンティティプロファイルとは、あなたに関するデジタル情報を集約し、あなたの行動、嗜好、属性などを詳細に表現したもの。

これは単なる氏名や住所といった基本情報だけでなく、オンラインでの行動履歴、購買パターン、SNSでの活動、位置情報など、多岐にわたるデータから構築されます。

従来の顔認証や指紋認証が盗まれると、アカウントの乗っ取りなどの被害に遭います。

ディープ・バイオメトリクスの場合、顔の微細な動きや声のトーン、癖といった、より詳細な生体情報を指すため、これを悪用されると、さらに悪質な犯罪が可能になりるのです。

ビジネスメール詐欺など、ディープフェイクと行動パターンの組み合わせで高い精度の詐欺が可能

顔や声だけでなく、行動の癖まで再現された偽プロフィールで被害者を騙せるため見破りにくい

政治家の発言や行動を完全に再現するため存在しないスキャンダルや虚偽発言を拡散できる

行動パターンを再現して「正常なユーザー」として認証するため、異常検知システムが機能しない

これらの詐欺は「行動的バイオメトリクス」まで再現されることから、被害者が不審に感じにくいという特徴があります。

デジタルアイデンティティの危機

行動的バイオメトリクスは、AIがあなたのデジタル上の「癖」を学習するようなもので、あなたの「いつものパターン」を確立し、不審な行動や異常を検知するために使用されるセキュリティレイヤー(複数の異なるセキュリティ対策を階層的に組み合わせたもの)となります。

このいつものパターンから大きく外れる行動(普段使わない場所からログインするなど)が検知されると、AIはそれを「不審な行動」と判断します。

この判断に基づいて、アカウントのロック、追加の認証要求やあなたへ通知するといった対応が自動的に行われます。

しかし、攻撃者があなたの行動的バイオメトリクスデータを入手した場合、あなたの「デジタル上の行動習慣」を再現できてしまう。

漏洩したあなたの行動的バイオメトリクスデータで、あなたと同じ行動ができるので、ある意味、「完全ななりすまし」というか「あなたそのもの」がもう一人いるのと同じような状態を作り出せてしまうのです。

AIはあなただと判断してしまい、異常検知システムがはたらかない、その結果、攻撃者はあなたになりすまして「正常なユーザー」として認証を継続できてしまうというわけ。

そして、本来のあなたがデジタル上で持っていた唯一無二の存在としてのアイデンティティが、もはや唯一のものではなくなってしまいますよね。

あなたのデジタルアイデンティティが「複製可能」になってしまい、それを信頼できない状態となり、アイデンティティの根本的な危機を招くという結果となるのです。

| リスクファクター | パスワード/PIN | ディープ・バイオメトリクス(指紋) |

|---|---|---|

| 変更可能性 | 容易に変更可能 | 事実上不可能(生涯不変) |

| データ流出後の危険期間 | 短期~中期(変更されるまで) | 永続的 |

| 悪用による二次的脅威 | アカウント乗っ取り | 永続的なアイデンティティ詐称、ディープフェイク悪用 |

| 法的影響(米国BIPAなど) | 低い(通常、生体情報に特有の罰則はない) | 極めて高い(集団訴訟リスク) |

あなたが今すぐ取るべき3つの対策

AI時代の新たなプライバシー危機に対抗するため、あなたは以下の3点を徹底しましょう。

多要素認証(MFA)を全ての重要アカウントで必須に

機密情報・個人を特定できる詳細な画像を入力しない

個人情報など自分のデータに対する権利を把握しておく

多要素認証(MFA)の徹底

生体データ(顔認証や指紋認証)は便利ですが、単独で認証に使用するのは危険です。

生体認証単独への依存を避け、PIN番号やワンタイムパスワード(OTP)と組み合わせるなど、「多要素認証(MFA)」を全ての重要アカウントで必須にしてください。これは、生体データが漏洩した場合でも、不正アクセスを防ぐためには必須となります。

人によって「重要アカウント」の定義は異なるとは思いますが、例えば、ショッピングサイトやサブスクで利用しているサービスなどですね。

次回の支払いがスムーズなようにクレジットカードを紐づけている方も多いのではないでしょうか。

そしてそのクレジットカードは、あなたの持つ銀行口座にも紐づけされているのでは?

AIサービスへの機密情報入力を回避する

サービス提供者は、安全機能の回避や機密情報・個人を特定できる詳細な画像を入力しないよう警告しています。

AIの利用規約やプライバシーポリシーに必ず目を通し、AIがデータから何を学習するかを確認しましょう。

あなた自身の身体的特徴や生活習慣が強く反映された写真は、情報が抜き取られるリスクを考慮し、アップロードを控えるべきだというのは、これまで書いてきたことからもわかりますよね。

自身の身体的特徴や生活習慣も個人情報の一部であり、機密情報だという認識を持ちましょう。

日本の個人情報保護法

自分のデータに対する権利を把握しておく、これはAIサービスに限ったことではなく、個人情報を必要とする、どのようなサービスにも当てはまります。

日本の個人情報保護法(PIPA)では、個人に対し、自己に関する個人データについて、開示、訂正、および利用停止(削除を含む)を請求する権利を認めています。

個人情報が不適正に利用されている、または利用目的を達成した後に保持されているなどの場合に、そのデータの削除や利用の停止を求めることが可能です。

関連記事

AIの進化で「人間の証明」が必要な時代到来|World IDを狙う詐欺に注意

AI利用規約を読まずに同意しては危険!あなたの存在がなくなるかも

見破れる?AIが仕掛ける最新フィッシング詐欺 脅威の裏側と対策

【ScamAgent】とは?AIが世界一の詐欺師になるかもしれない

あなたのAIが勝手に決済?AIエージェントを狙うプロンプトインジェクションの脅威

【AIがあなたの情報を盗む時代】個人でできるサイバーセキュリティ

その愛してるは本物?SNSやマッチングアプリに潜む【ロマンス詐欺】の手口

見抜けるか?AIが仕掛けるディープフェイク詐欺と論文不正の衝撃